시선 추적을 활용한 패션 디자인 인지에 관한 연구

© 2021 (by) the authors. This article is an open access article distributed under the terms and conditions of the Creative Commons Attribution license (http://creativecommons.org/licenses/by/3.0/), which permits unrestricted use, distribution, and reproduction in any medium, provided the original work is properly cited.

Abstract

This study investigated the cognitive process of fashion design images through eye activity tracking. Differences in the cognitive process and gaze activity according to image elements were confirmed. The results of the study are as follows. First, a difference was found between groups in the gaze time for each section according to the model and design. Although model diversity is an important factor leading the interest of observers, the simplicity of the model was deemed more effective for observing the design. Second, the examination of the differences by segments regarding the gaze weight of the image area showed differences for each group. When a similar type of model is repeated, the proportion of face recognition decreases, and the proportion of design recognition time increases. Conversely, when the model diversity is high, the same amount of time is devoted to recognizing the model’s face in all the processes. Additionally, there was a difference in the gaze activity in recognizing the same design according to the type of model. These results enabled the confirmation of the importance of the model as an image recognition factor in fashion design. In the fashion industry, it is important to find a cognitive factor that attracts and retains consumers’ attention. If the design recognition effect is further maximized by finding service points to be utilized, the brand’s sustainability is expected to be enhanced even in the rapidly changing fashion industry.

Keywords:

cognition, eye tracking, fashion design, image elements키워드:

인지, 시선 추적, 패션디자인, 이미지 요소1. 서 론

인상이란 대인의 지각에 의해 이루어지는 이미지로, 인상형성은 상대방에 관해 알고 있는 정보들을 종합하고 그 중 일관성을 보이는 특징을 찾아낸 후 이해하는 일련의 과정이다. 이 과정에서 추론된 특징을 바탕으로 상대방에 대해 전반적인 판단을 내리게 되며(Kaiser, 1990), 결국 인상이란 여러 단서들을 통해 타인이 추론해낸 한 사람의 특징이라고 할 수 있다(Chae et al., 2016). 사람들은 누구나 타인에게 자신이 긍정적으로 인식되기를 바라는 기본적인 욕구를 가지고 타인이 지각하는 자신에 대해 영향을 미치려는 일련의 의식적, 무의식적인 행동을 한다. 타인들에 의해 비춰지는 자신의 모습에 관심을 기울이고 이러한 관심은 행동패턴의 동기로 작용하기 때문에 개인에게 인상관리는 매우 중요한 삶의 활동으로 여겨진다(Hancock & Dunham, 2001; Leary & Kowalski, 1990). 인상형성과 관련하여 사회심리학에서는 대인지각(person perception)이라는 이름으로 인상형성과 관련한 수많은 연구들이 귀인, 사회적 추론, 태도 연구 등과 더불어 사회 인지(social cognition) 영역에서 중요한 분야 중 하나로 다루어져왔다(Park et al., 2007).

인지(cognition)란 ‘cognoscere(알다)’라는 라틴어 동사에서 유래되었고, ‘인지적’, ‘인지’라는 용어는 프랑스에서 14C부터 ‘인식하도록 하는 것’이라는 일반적 의미로 사용되기 시작하였다. 19C와 20C에 이르러서 ‘인식에 관한 학문’이라는 의미로 학문의 한 분야로 지칭되었으며, 인간의 심리에서 자극을 받아들이고 저장, 인출하는 정신과정, 지각, 기억, 상상, 개념, 판단, 추리를 포함한 ‘무엇을 안다’라는 포괄적인 용어로 정의할 수 있다(Choi, 2002). 광의의 인지는 ‘지각’(외부 자극을 1차적으로 처리하여 받아들이는 과정)도 포함하지만, 협의로 정의하면 ‘인지(cognition)’는 ‘지각(perception)’과 구분되며, 보다 구체적인 정보의 처리, 조직, 재편성, 학습, 이해, 저장, 추출, 응용 등의 과정을 거친다. 또한 기존 인지 정보들과 결합하여 행동으로 나타나게 되는 과정도 포함한다(Kim, 2010). 이런 과정들을 통해 인간은 새로운 환경에 적응해 가며 지식 및 정보를 수정, 축척하고 필요에 따라 인출하여 활용하게 된다. 인간의 문제해결 능력인 ‘인지’ 과정에 대해 연구하는 분야가 인지심리학이다. Neisse(1967)는 인지심리학을 ‘감각 정보가 변형, 축소, 정교화되고, 저장, 인출되며 활용되는 모든 과정’을 연구하는 학문이라고 정의하였다. 즉 정보의 습득, 저장, 인출 및 활용의 단계에서 어떤 일들이 일어나는지를 연구한다(Lee, 2019b).

인지 과정에 있어, 눈의 움직임은 신체 움직임 중에서 매우 빠르고 자주 일어나는 움직임으로 로버트 뮈르(Robert Muir)는 인간의 신체 감각기관 중 83%가 시각을 통해 외부 정보를 획득한다고 했다. 눈의 움직임은 복잡하고, 정교하며, 진보적인데 이러한 눈의 움직임은 독자적으로 이루어지는 것은 아니며 눈으로 획득한 정보의 내용에 따라 ‘정보를 찾는 일’을 계속하는 과정에서 빠른 움직임이 수반되는 것이다(Ryu, 2019). 눈의 움직임, 즉 시선은 ‘눈에서 물체를 주시하는 선’이라 정의하며, 시선의 방향은 눈, 얼굴, 신체 등의 운동에 따라 원하는 방향으로 시선을 향하는 것으로 정의되어 있다(Doosan Encyclopedia, 2009). 시선은 인간이 대상을 지각하는 방법이자, 인지의 과정을 드러내는 단서이다.

시선 추적은 눈의 위치와 눈의 움직임을 측정하는 기술로, 사람이 특정한 곳을 응시하고 있는지를 측정 및 기록하는 것이다(Holmqvist et al., 2011). 시선 추적 기법은 동공의 반응을 추적하여 ‘보이는 것’의 의미를 해석하고 있는데, 관찰자의 시선이 어디에 머물러 있으며, 얼마나 오래, 얼마나 자주 그것을 보는지를 측정할 수 있는 기법이다. 교육학(Jang, 2021; Kim et al., 2019; Lee, 2019a; Song, 2018), 인간공학(Jo & Sung, 2019; Park & Yim, 2021), 커뮤니케이션(Chung et al., 2018; Park & Lee, 2021; Ryu, 2019; Wang et al., 2021) 관련 분야에서 분석기법으로 쓰이고 있으며, 사용자 경험에 의거한 사용성 평가실험이 주를 이루고 있다(Lee & Lee, 2010). 이는 인간 동공의 시선 고정이 그 지점에서 유의미한 인지 활동이 일어나고 있음을 전제한다(Lee et al., 2019) 다시 말해, 눈의 움직임에 대한 분석을 통하여 인간의 인지 및 사고에 대한 과학적인 근거를 제공할 수 있다고 설명하는데, 이는 눈의 움직임이 문장이나 그림 등 특정 부분에 고정될 때, 그것에 대하여 인지적으로 생각을 하게 되며, 그 비율은 정확히 그 고정된 시간과 비례한다는 eye-mind 가설(Just & Carpenter, 1980)에 기반한다.

이러한 시선 추적 기법은 기존의 연구방법으로 관찰하기 어려운, 인간의 뇌활동에 대한 정밀한 자료를 수집하는데 도움을 줄 수 있다. 초기의 시선 추적 장치들은 콘택트렌즈나 필름 등을 활용하여 눈의 움직임을 기록하였고, 이후 안구 전기 신호의 측정이나 안구 반사광의 기록을 통하여 자료 수집의 정확성을 높여나갔다(Choi & Cho, 2012). 최근에는 관련 테크놀로지의 발달에 따라 머리의 움직임과 관계없이 눈의 움직임을 기록할 수 있는 소형의 기기들이 개발됨에 따라 시선 추적을 활용한 다양한 분야의 연구가 증가하고 있다(Lee, 2019a).

패션디자인에 있어 인지의 측면은 이미지 감성을 형성하는 중요한 과정으로, 디자인 의도를 적절하게 전달할 수 있는 인지 과정에 대한 이해는 패션 연출에 중요한 단서를 제공한다. 패션 분야에서 시선 추적을 활용한 선행 연구를 살펴보면, Zofija and David(2020)는 모바일 쇼핑에서의 소비자 행동 연구를 위해 시선 추적 기술을 활용했으며, Amatulli et al.(2016)는 명품 브랜드 인지도에 관한 연구를 수행함에 있어, 실증 테스트를 위해 시선 추적을 활용하였다. 패션 이미지 인지에 관한 연구로 Ju and Johnson은 패션 광고 이미지를 바라보는 시선을 추적하였으며, 광고 요소 중 모델의 시선 비중이 높았음을 밝혔다. Park et al.(2012)의 연구에서는 디자인 교육을 받은 관찰자가 그렇지 않은 관찰자에 비해 디자인 변경에 더 민감하고 집중된 시선 활동을 보이고 있음을 시선 추적 실험을 통해 실증적으로 보여주었다. Hu et al.(2009)는 여성 코트 디자인에 있어 실루엣, 칼라, 길이, 소매, 어깨 유형이 브랜드 스타일에 영향을 미치는 디자인 요소라고 하였으며, Lee(2018)는 모델 유형과 함께 디자인의 복잡성과 단순성이 시선 활동 경로의 활발함에 영향을 끼치는 인지 요소라 하였다. 이러한 연구들에서 시선 추적은 패션 인지 과정에 대한 정밀한 데이터를 제공함으로써 연구 결과의 실증적 해석에 도움을 줄 수 있음을 보여주고 있다. Zhang et al.(2014)은 패션 및 제품 디자인 분야에서 시선 추적을 활용한 연구들의 문헌 분석을 통해 시선 추적 기법을 활용한 산업적, 학술적 성장 가능성에 대해 언급하였으며, 특히 디자인의 주관적 평가와 함께 시선 추적을 활용한 객관적 데이터의 중요성을 시사하였다.

착용자를 중심으로 이미지를 형성하는 패션의 특성으로 인해 디자인이 전달하는 감성은 일반 제품디자인과는 차이가 있다. 따라서 디자인 인지에 관한 이론은 보다 패션에 적합하게 응용, 분석되어야 할 분야로, 디자인을 인식하고 평가하는 일련의 과정을 기록하고 다양한 자극물에 대한 관찰자의 반응 차이를 측정하는 연구는 그 중요성에 비해 미흡한 것으로 사료된다.

본 연구는 시선 활동 추적을 통해 패션디자인 이미지의 인지 과정을 살펴보고자 한다. 시선 활동의 특이점을 유발하는 이미지 인지 요소를 살펴보고, 이를 통해 패션디자인의 인지 과정을 보다 구체화하고자 한다. 패션이미지의 인지 요소에 관한 과학적 데이터를 제공함으로써 인지 과정을 활용한 산업적 응용 및 디자인 인지 분야의 학술적 발전에 기여하고자 한다.

2. 연구문제 및 연구방법

패션디자인 이미지 인지 과정에서의 시선 추적을 위한 이미지 인지 요소는 모델과 디자인으로 구분하여 다음과 같은 연구문제를 설정하였다.

연구문제 1. 이미지 요소에 따라 관찰구간에 따른 응시 시간 차이를 보일 것이다.

연구문제 2. 이미지 요소에 따라 관찰구간에 따른 응시구역 별 응시 비중 차이를 보일 것이다.

이미지 요소에 따른 인지 과정, 시선 활동 차이를 확인하기 위해 모델 요소와 디자인 요소 조작 실험을 수행하였다. 연구방법은 다음과 같다.

2.1. 실험 이미지

본 연구자는 선행 연구(Lee, 2015)를 통해 2014 S/S Paris 컬렉션 중 모델의 외적통일성이 높거나 낮은 컬렉션 그룹을 선별하였다. 모델의 외적 통일성이 높은 경우, 인종은 백인, 동일한 헤어메이크업으로 개별 모델의 개성이 거의 드러나지 않는 다소 단순한 시각적 표현으로 나타났다. 반면 모델의 외적 다양성이 높은 컬렉션은 황인, 흑인을 포함한 다양한 인종 구성과 함께 개별 모델의 개성이 드러날 수 있는 다양한 헤어메이크업을 선보였다. 해당 연구 결과에 따라 모델의 외적통일성이 높게 나타난 컬렉션 그룹 중, 질적 분석을 통해 디자인의 시각적 단순성이 가장 높았던 Issey Miyake 컬렉션이 자극 그룹 A로 선정되었으며, 모델의 외적통일성이 낮게 나타난 컬렉션 그룹 중, 디자인의 시각적 복잡성이 가장 높았던 Jean-Paul Gaultier 컬렉션이 자극 그룹 B로 선정되었다. 시각적 단순성과 복잡성은 전체 컬렉션 이미지를 대상으로 색, 소재, 문양, 질감, 디테일, 코디네이션 등을 살펴보았으며, 패션 전공 교수 2인과 학부생 2인의 합의에 의해 결정되었다. 모델의 외적 통일성이 높게 나타난 5개의 컬렉션 중 Issey Miyake 컬렉션은 전반적으로 심플하고 미니멀한 컨셉으로 컬렉션 전체 디자인의 통일성도 높았다. Jean-Paul Gaultier 컬렉션은 다양한 표면의 소재 활용과 복잡한 디테일로 모델의 다양성이 높았던 4개의 컬렉션 중 디자인의 복잡성이 가장 높은 컬렉션으로 판단되었다.

www.style.com을 통해 Issey Miyake는 전체 41컷, Jean-Paul Gaultier는 전체 54컷이 실험 자극 원본으로 수집되었으며, 해당 컷들 중 모델의 중복 여부 및 디자인의 단순성, 복잡성을 근거로 컬렉션별 최종 40컷의 실험 자극 이미지가 선정되었다. 선정된 실험자극 이미지들은 포토샵을 통해 배경이 일괄적으로 통일되었으며, 디자인 구역과 모델 구역을 분리, 교합을 통해 총 4개 그룹, 160컷으로 편집, 합성되었다(Fig. 1~4).

2.2. 시선 활동 추적

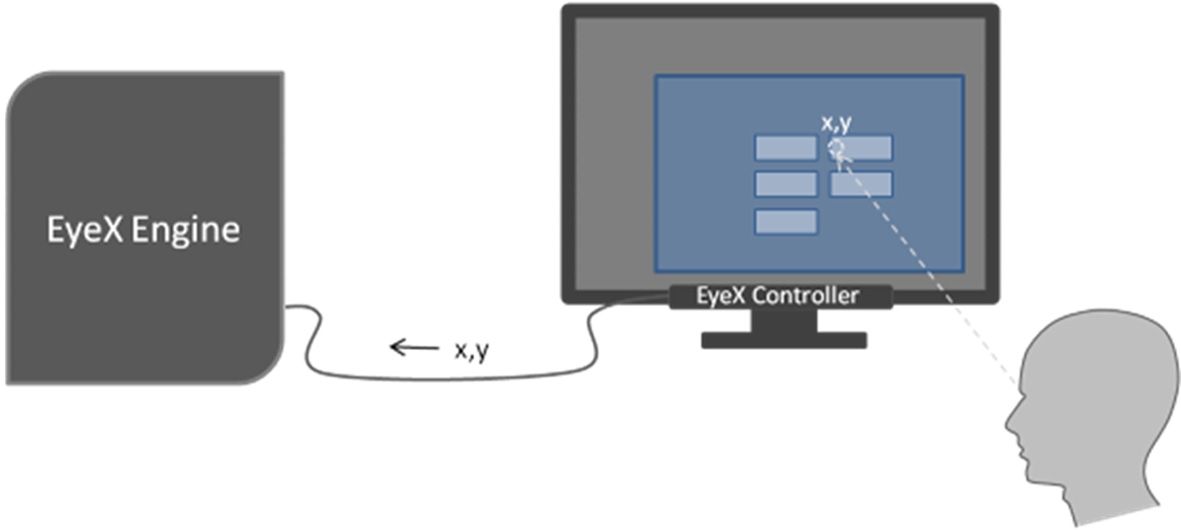

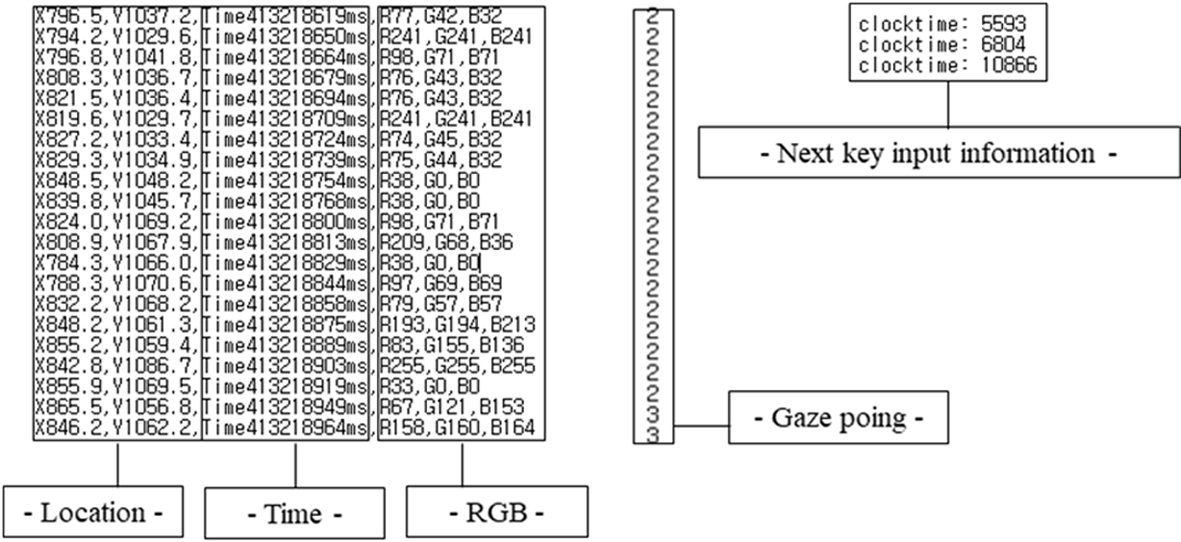

실험 이미지들은 1컷 단위 슬라이드 형식으로 배열되어 그룹별 실험 참가자에게 노트북 화면으로 제공되었다(Fig. 5). 실험은 1명씩 단독으로 진행되었으며, 연구자는 실험 참가자에게 실험에 대해 설명한 뒤 5미터 이상 거리를 두어 실험 참가자가 편안한 상태로 실험에 임할 수 있도록 하였다. 실험을 위해 시각 센서를 활용한 IT 개발 전문가 자문을 통해 ‘Tobii EyeX(Fig. 6)’ 장치를 활용한 시선 추적 프로그램을 개발하였다(Fig. 7). 노트북을 통한 이미지 응시 과정에서 시선 활동은 ‘Tobii EyeX’ 장치에 의해 감지되며, 모델의 신체 부위에 근거, 전체 응시 구역을 3등분하여 각 부위에 머무르는 시선 활동(위치, 시간 등)에 대해 기록할 수 있도록 프로그램 되었다(Fig. 8). 실험 시작과 동시에 첫 슬라이드에서 마지막 슬라이드까지 감상하는데 걸리는 시간 및 각 슬라이드 별 감상 시간이 측정되며, 실험 참가자의 시선 추적을 통해 3등분 된 이미지 구역 중 어느 위치에서 가장 많은 응시 활동이 있었는지 등 모델 및 디자인 인지 과정 전반에 관한 시선 활동 측정을 수행하였다(Fig. 9).

3. 실험 결과 및 분석

1년 이상의 패션 관련 업무 종사자 혹은 대학 패션 전공자를 대상으로 실험 참가자를 모집하였으며, 실험 참가자는 이미지를 응시함에 있어 충분히 감상한 후 다음 이미지로 넘어가도록 권유되었다. 실험 참가 순서에 따라 A, B, C, D그룹으로 순차적 배정이 이뤄졌으며, 각 그룹별 40개의 이미지는 실험 참가자 모두에게 동일한 순서로 제공되었다. 각 그룹의 이미지는 Fig. 10과 같이 1~10번째 이미지는 관찰1구간, 11~20번째 이미지는 관찰2구간, 21~30번째 이미지는 관찰3구간, 31~40번째 이미지는 관찰4구간으로 구분하여 그룹 내 각 구간별 시선 활동을 살펴봄과 동시에 4개 그룹 간 차이를 분석하였다.

전체 40명의 실험참가자는 각각 40개의 이미지를 응시하였으며, 수집된 총 1600개 시선추적 데이터는 SPSS Win 27을 사용하여 일원배치 분산분석(ANOVA)을 실시 하였다. 분산분석을 통해 시선활동의 특이점이 발생하는 관찰구간 및 이미지 응시구역별 항목간 차이를 살피고, Duncan test를 통해 이를 검증하였다. 분석 결과는 다음과 같다.

3.1. 관찰구간별 응시 시간 경향 비교

A그룹 이미지의 총 응시 시간 및 평균의 구간별 차이를 살펴본 결과(Table 1), 모델과 디자인 모두 단순했던 이미지 그룹 A는 구간별 응시 시간 차이가 없는 것으로 나타났다. 다시 말해, 실험 참가자들은 해당 그룹의 40개 이미지를 응시하는 동안 초반부터 끝까지 각 이미지를 응시함에 있어 대부분 비슷한 시간을 소요한 것으로 이해되었다.

반면, B그룹 이미지의 총 응시 시간 및 평균의 구간별 차이를 살펴본 결과(Table 2), 모델과 디자인 모두 복잡했던 이미지 그룹 B는 구간별 응시 시간에 차이가 있는 것으로 나타났다. 즉, 실험 참가자들은 해당 그룹의 이미지를 응시하는 동안 초반에는 좀 더 많은 시간을, 후반으로 갈수록 짧은 시간을 소요함으로써 전체 40개의 패션 이미지를 인지함에 있어 구간별 차이를 드러냈다.

모델은 단순하지만 디자인은 복잡하게 조작된 이미지 그룹 C의 총 응시 시간 및 평균의 구간별 차이를 살펴본 결과(Table 3), 후반 4구간이 응시 시간이 가장 짧기는 하였으나, 그 앞 3 구간의 응시 시간은 가장 길게 측정되었다. 초반 1, 2구간에 비해 3구간에 긴 응시 시간을 나타내는 것은 시간이 갈수록 응시 시간이 짧았던 B그룹 결과와도 다른데, 디자인이 같고 모델의 유형만 달랐던 두 그룹의 이런 차이는 패션이미지에 있어 모델이라는 인지 요소가 영향을 끼치고 있음을 확인할 수 있는 결과였다.

한편, 모델은 다양하지만 디자인은 단순하게 조작된 이미지 그룹 D의 총 응시 시간 및 평균의 구간별 차이를 살펴본 결과(Table 4), 실험 참가자들은 해당 그룹의 이미지를 응시하는 동안 초반에는 좀 더 많은 시간을, 후반으로 갈수록 짧은 시간을 소요함으로써 전체 40개의 패션 이미지를 인지함에 있어 구간 별 차이를 드러냈다. 이러한 경향은 모델과 디자인 모두 복잡했던 B그룹의 경향과 유사한데, 디자인의 단순, 복잡성을 떠나서 모델의 복잡성이 높은 경우 초반 이미지 응시에 많은 시간을 할애 한다는 것을 알 수 있었다. 여기에 D그룹과 모델은 다르지만 디자인이 같았던 A그룹이 각 구간별 응시 시간 차이가 없었던 결과와 비교하면, 같은 디자인이더라도 모델의 다양성이 각 디자인 인지에 차이를 불러일으키는 중요한 인지 요소인 것으로 판단되었다.

3.2. 관찰구간 및 응시구역별 응시 비중 경향 비교

Table 5, 6, 7, 8은 실험 참가자들이 각 이미지를 응시하는 시간을 100으로 보았을 때, 이미지 1구역의 응시 비중의 구간 별 차이를 보여준다. 이미지에서 1구역은 모델의 얼굴에 해당하는 지점으로, A그룹의 경우 후반 4구간의 1구역 응시 시간 비중이 짧게 나타났다(Table 5). 다시 말해, 전체 40개의 이미지를 감상함에 있어 마지막 구간 즈음에서 전체 이미지 중 얼굴을 보는 비중이 낮아진 것이다.

반면, B그룹의 경우 전체 구간에서 1구역 응시 시간 비중에 차이가 없는 것으로 나타났다(Table 6). 모델의 다양성이 높았던 B그룹을 응시하는 실험 참가자들이 구간에 상관없이 처음부터 끝까지 모델의 얼굴을 응시하는데 같은 비중을 둔 것이다.

모델은 단순하지만 디자인은 복잡하게 조작된 이미지 그룹 C의 1구역 응시 비중은 중후반으로 갈수록 짧아져 구간별 차이가 있음을 확인하였다(Table 7). 이는 유사성이 높은 단순한 모델의 얼굴을 인지하는 데 들이는 시간이 후반으로 갈수록 짧아지고 대신 디자인 구역인 2, 3구역으로 시선 비중이 옮겨졌음을 의미한다. 모델 유형이 같았던 A그룹 역시 후반 응시 비중이 짧아진 결과를 보았을 때, 모델의 단순성이 이미지 인지 과정에 있어 디자인 인지에 영향을 끼치는 것으로 사료되었다.

한편, 모델은 다양하지만 디자인은 단순하게 조작된 이미지 그룹 D의 1구역 응시 비중은 구간별 차이가 없는 것으로 나타났다(Table 8). 이미지를 인지하는 과정에서 모델의 다양성으로 인해 초반부터 후반까지 모델의 얼굴을 응시하는데 같은 비중의 시간을 할애한 것이다.

Table 9, 10, 11, 12는 실험 참가자들이 각 이미지를 응시하는 시간을 100으로 보았을 때, 이미지 2구역의 응시 비중의 구간별 차이를 보여준다. 이미지에서 2구역은 모델의 상체에 해당하는 지점으로 디자인 구역이다.

A그룹의 경우 1, 2, 3구간 동안 2구역 응시 시간 비중에 차이가 없다가 후반 4구간의 비중이 짧게 나타났으며(Table 9), B그룹의 경우 2구간의 2구역 응시 시간 비중이 다른 구간에 비해 높게 나타났다(Table 10). C그룹은 4구간의 2구역 응시 시간 비중이 짧게 나타났으며(Table 11), D그룹은 4구간의 2구역 응시 시간이 가장 짧지만, 그 앞선 3구간의 2구역 응시 비중이 높았다(Table 12).

Table 13, 14, 15, 16은 실험 참가자들이 각 이미지를 응시하는 시간을 100으로 보았을 때, 이미지 3구역의 응시 비중의 구간별 차이를 보여준다. 이미지에서 3구역은 모델의 하체에 해당하는 지점으로 디자인 구역이다.

A그룹의 경우 1, 2구간에 비해 3구간 이미지들에서 응시 시간 비중이 짧게 나타났으며 다시 4구간에서는 3구간에 비해 살짝 높아진다(Table 13). 위 Table 9의 결과와 종합해볼 때, A그룹의 3, 4구간 디자인 이미지를 인지함에 있어 시선 차이를 불러일으키는 요소가 2, 3구역에 있는 것으로 판단되었다. 다시 말해, A그룹 3구간 디자인(Fig. 11)들은 상체에, 4구간 디자인(Fig. 12)들은 하체에 상대적인 특이점이 있는 것이다.

B그룹의 경우 1구간의 3구역 응시 시간 비중이 2, 3, 4구간에 비해 높은 것으로 나타났다(Table 14). 위 Table 10의 결과와 종합해볼 때, B그룹의 1, 2구간 디자인 이미지를 인지함에 있어 시선 차이를 불러 일으키는 요소가 2, 3구역에 있는 것으로 판단되었다. 다시 말해, B그룹 1구간 디자인(Fig. 13)들은 하체에, 2구간 디자인(Fig. 14)들은 상체에 상대적인 특이점이 있는 것이다.

C그룹의 경우 1구간 3구역 응시 시간 비중이 높고 2, 3구간은 1구간 보다 낮은 응시 비중을, 4구간은 가장 낮은 3구역 응시 비중을 보여준다(Table 15). 다른 그룹들에 비해 C그룹은 2, 3구역 디자인 인지를 위한 시선 비중에 있어 구역별 차이가 크지 않은 것으로 보였는데, 이는 모델의 단순성이 높았던 C그룹 이미지를 응시함에 있어 실험 관찰자들이 디자인을 전체적으로 고르게 응시 했다는 것으로 해석되었다.

D그룹의 경우 1, 2구간 3구역 응시 시간 비중이 3, 4구간 비중에 비해 높게 나타났다(Table 16). 위 Table 12의 결과와 종합해볼 때, D그룹의 3구간 디자인 이미지를 인지함에 있어 시선 차이를 불러일으키는 요소가 2구역에 있는 것으로 판단되었다. 다시 말해, D그룹 3구간 디자인(Fig. 15)들은 상체에 상대적 특이점이 있는 것이다. D그룹과 모델 유형은 다르지만 디자인이 같은 A그룹의 결과와 비교해볼 때, 3구간 디자인들의 상체에 특이점이 있는 것으로 시선 추적 결과가 나온 것은 동일하지만, 4구간 디자인들의 하체에 특이점이 있는 것을 확인할 수 있었던 A그룹 결과와 달리 D그룹 결과는 4구간 3구역의 응시 비중이 높지 않았는데, A그룹 모델의 단순성이 전체 디자인을 좀 더 확인할 수 있는 여건을 마련해주고 있는 것으로 판단되었다.

이러한 결과를 정리하면 Table 17과 같다.

4. 결 론

본 연구는 시선 활동 추적을 통해 패션디자인 이미지의 인지 과정을 살펴보았다. 이미지 요소에 따른 인지 과정, 시선 활동 차이를 확인하였으며, 연구 결과는 다음과 같다.

첫째, 각 그룹 이미지의 총 응시 시간 및 평균의 구간별 차이를 살펴본 결과, 모델과 디자인에 따라 각 구간별 응시 시간에는 그룹별 차이가 있었다. 모델의 단순성이 높았던 A그룹과 C그룹에 비해, 모델의 다양성이 높았던 B그룹과 D그룹의 후반 응시 시간이 짧은 경향으로 나타났는데, 이는 모델의 다양성이 초반 관찰자의 흥미를 이끄는 중요한 요소로 작용하지만, 디자인을 끝까지 유사한 비중으로 관찰하는데는 모델의 통일성이 높은 것이 좀 더 유효한 것으로 사료되었다.

둘째, 이미지 응시구역의 응시 비중에 대한 구간별 차이를 살펴본 결과, 각 그룹은 이미지 구역별 응시 비중에 있어 구간에 따른 차이를 나타냈다. 패션디자인 이미지 인지 요소를 모델과 디자인, 두 개 영역으로 구분하였을 때, 모델을 인지하는 1구역 응시 비중과 디자인을 인지하는 2, 3구역 응시 비중이 전체 40개의 이미지를 응시하는 전체 과정 동안 구간별로 다른 응시 비중을 보인 것이다. 모델의 단순성이 높았던 A그룹과 C그룹의 경우, 응시 초반에 비해 후반으로 갈수록 모델의 얼굴인 1구역 응시 비중이 낮아짐으로써, 실험참가자들이 비슷한 유형의 모델이 반복되는 경우 후반으로 갈수록 얼굴을 인지하는데 들이는 시간 비중을 줄이고 디자인을 인지하는 데 들이는 시간 비중을 늘린 것을 확인할 수 있었다. 이에 반해, 모델의 다양성이 높았던 B그룹과 D그룹의 경우 전체 40개의 이미지를 응시하는 전체 과정 동안 모델의 얼굴을 응시하는 비중이 구간에 따라 차이가 없는 것으로 나타났다. 이는 모델의 다양성으로 인해 실험참가자들이 패션이미지를 인지하는 모든 과정에서 모델의 얼굴을 인지하는데 동일한 시간 비중을 할애한 것이다. 한편, 모델의 유형에 따라 같은 디자인을 인지하는 시선 활동에도 차이가 있었는데, 모델이 단순하고 디자인도 단순했던 A그룹은 같은 디자인이어도 모델이 복잡했던 D그룹에 비해 디자인을 좀 더 세밀히 구분해내는 경향이 있는 것으로 사료되었다. 여기에 모델의 다양성이 높고 디자인이 복잡했던 B그룹에 비해 같은 디자인이어도 모델이 단순했던 C그룹은 디자인을 전체적으로 인지하려는 시선 활동을 보이는 것으로 판단되어 디자인 인지 요소로써 모델의 중요성을 다시 확인할 수 있었다.

이러한 결과는 패션 기획에 있어 디자인 특성 및 프레젠테이션 의도에 유효한 모델 선정과 연출을 위한 단서를 제공하며, 더 나아가 브랜드 컨셉을 소비자에게 인지시키는 과정에서 패션 이미지의 전략적 활용에 적용될 수 있을 것이다. 수많은 패션 이미지를 통해 전개되는 패션 산업에서, 소비자의 시선을 끌고 머물게 하는 인지 요소를 찾아내고 이를 활용할 수 있는 서비스 포인트를 찾아냄으로써 디자인 인지 효과를 더욱 극대화한다면 빠르게 변화하는 패션 산업에서도 브랜드의 지속가능성을 높일 수 있을 것으로 기대한다.

패션디자인 인지 과정의 특수성을 이해하고 전략적으로 활용하기 위해서는 관련 연구가 활발히 진행되어져야 할 것으로 사료되며, 이에 본 연구는 패션디자인 인지에 관한 데이터 기반 연구를 수행함으로써 보다 객관적인 분석 자료에 기반 한연구 결과를 제공함에 그 연구의 의의가 있다. 그러나 시선 추적 실험 과정에 있어, 이미지를 응시하는 실험 참가자의 개별적 특성에 의해 이미지를 인지하는 전체 시간의 편차가 높아 본 실험의 분석 결과를 확대 해석함에는 유의해야 할 것이다. 이에 후속연구에서는 전체 응시 시간을 제어할 수 있는 실험 설계를 통해 이미지 응시 초반, 중반, 후반의 시선 활동 분석을 수행하고자 한다. 이를 통해 패션디자인 이미지를 응시하는 관찰자의 인지 활동을 보다 정밀하게 살펴보고자 하며, 연구 결과의 신뢰성 및 정교함을 더하고자 한다.

Acknowledgments

이 논문은 2016년 대한민국 교육부와 한국연구재단의 지원을 받아 수행된 연구임(NRF-2016S1A5A8017764).

References

-

Amatulli, C., Guido, G., Mileti, A., Tomacelli, C., Prete, M. I., & Longo, A. E. (2016). “Mix-and-Match” fashion trend and luxury brand recognition - An empirical test using eye-tracking. Fashion Theory, 20(3), 341-362.

[https://doi.org/10.1080/1362704X.2015.1082294]

-

Chae, H. J., Park, S. H., & Ko, E. J. (2016). A study on fashion brand online impression formation and its WOM effect according to online review types of supporters. Fashion & Textile Research Journal, 18(1), 15-26.

[https://doi.org/10.5805/SFTI.2016.18.1.15]

- Choi, D. S. (2002). Ergodesign. Seoul: Ahn Graphics.

- Choi, Y. L., & Cho, S. H. (2012). Eye tracking system status and utilization. Digital Contents Society Review, 8(1), 9-14.

-

Chung, H. Y., Lee, J. Y., & Nam, Y. J. (2018). Influence of endorser's gaze direction on consumer's visual attention, attitude and recognition - Focused on the eye movement. The Korean Journal of Advertising, 29(7), 29-53.

[https://doi.org/10.14377/KJA.2018.10.15.29]

- ‘Data generation diagram’. (n. d.). tobii.com. Retrieved March 07, 2018, from http://developer.tobii.com/an-introduction-to-the-tobii?eyexsdk/

- Doosan Encyclopedia. (2009). Seoul: Doosan Donga.

-

Hancock, J. T., & Dunham, P. J. (2001). Impression formation in computer-mediated communication revisited. Communication Research, 28, 325-347.

[https://doi.org/10.1177/009365001028003004]

- Holmqvist, K., Nyström, N., Anderson, R., Dewhurst, R., Jarodzka, H., & Weijer, J. (2011). Eye tracking - A comprehensive guide to methods and measures. UK: Oxford University Press.

- Hu, F., Su, X., & Guo, J. (2009). Eye-tracking study of woman coat's brand style. Chinese Journal of Ergonomics, 15(2), 27-32.

- ‘Issey Miyake 2014 S/S’. (n. d.). Style.com. Retrieved April 24, 2014, from http://www.style.com/fashionshows/complete/S2014RTWꠓIMIYAKE

-

Jang, D. M. (2021). Analysis of the reading patterns of pre-service elementary school teachers Korean language lesson plan based on using eye tracker. Journal of Learner-Centered Curriculum and Instruction, 21(3), 373-401.

[https://doi.org/10.22251/jlcci.2021.21.3.373]

- ‘Jean-Paul Gaultier 2014 S/S’. (n. d.). Style.com. Retrieved April 24, 2014, from http://www.style.com/fashionshows/complete/S2014RTWꠓJPGAULTIER

-

Jo, H. L., & Sung, J. E. (2019). Age-related differences in word recognition task according to the interference types - Evidence from eye-tracking. Communication Sciences and Disorders, 24(1), 186-204.

[https://doi.org/10.12963/csd.19584]

-

Ju, H. W., & Johnson, K. K. P. (2010). Fashion advertisements and young women - Determining visual attention using eye tracking. Clothing and Textiles Research Journal, 28(3), 159-173.

[https://doi.org/10.1177/0887302X09359935]

-

Just, M., & Carpenter, P. (1980). A theory of reading - From eye fixations to comprehension. Psychological Review, 87(4), 329-354.

[https://doi.org/10.1037/0033-295X.87.4.329]

- Kaiser, S. B. (1990). The social psychology of clothing: Symbolic appearances in context (2nd ed.). New York: Macmillan.

-

Kim, S. E., Chun, H. K., & Lee, B. H. (2019). Children’s picture book reading by image type and reading proficiency - Eye tracking study. The Journal of Korea Open Association for Early Childhood Education, 24(5), 293-313.

[https://doi.org/10.20437/KOAECE24-5-14]

- Kim, S. Y. (2010). A study on recognition receptivity in UI design of digital news: Focused on digital media news contents. Unpublished doctoral dissertation, Dankook University Graduate School.

-

Leary, M. R., & Kowalski, R. M. (1990). Impression management - A literature review and two-component model. Psychological Bulletin, 107(1), 34-47.

[https://doi.org/10.1037/0033-2909.107.1.34]

- Lee, B. H. (2019a). Development of eye tracker system for early childhood, Journal of the Korea Contents Association, 19(7), 91-98.

- Lee, J. H., & Lee, K. P. (2010). The method for measuring the initial stage of emotion in use context. The Science of Emotion & Sensibility, 13(1), 111-120.

-

Lee, J. M. (2019b). A study on the relationship between design and need · memory systems of the human brain - Focusing on related principles of cognitive psychology. Journal of the Korea Institute of Spatial Design, 14(6), 271-286.

[https://doi.org/10.35216/kisd.2019.14.6.271]

-

Lee, K. H., Choi, S. K., Lee, G. N., Kang, S. H., & Kim, T. H. (2019). Development of reading ability diagnosis indicators using eye tracker. Brain, Digital, & Learning, 9(2), 19-28.

[https://doi.org/10.31216/BDL.2019.9.2.019]

-

Lee, S. Y. (2015). Analysis of design concept based on the level of consistency in fashion show models` physical appearance - Focus on S/S Paris collection 2014. Fashion & Textile Research Journal, 17(5), 718-730.

[https://doi.org/10.5805/SFTI.2015.17.5.718]

-

Lee, S. Y. (2018). A study on the differences in cognition of design associated with changes in fashion model type - Exploratory analysis using eye tracking. Fashion & Textile Research Journal, 20(2), 167-176.

[https://doi.org/10.5805/SFTI.2018.20.2.167]

- Neisser, U. (1967). Cognitive psychology. New Jersey: Englewood Cliff.

- Park, C. Y., Kim, J. H., Kim, Y. H., Kim, M. J., Choi, E. S., & Hur, T. K. (2007). Active information seeking in impression formation - Generation and gender differences. Korean Journal of Woman Psychology, 12(2), 123-143.

-

Park, J., DeLong, M., & Woods, E. (2012). Exploring product communication between the designer and the user through eye-tracking technology. International Journal of Fashion Design Technology and Education, 5(1), 67-78.

[https://doi.org/10.1080/17543266.2011.633566]

-

Park. J. H., & Yim, K. B. (2021). Technical survey on the real time eye-tracking pointing device as a smart medical equipment. Smart Media Journal, 10(1), 9-15.

[https://doi.org/10.30693/SMJ.2021.10.1.9]

-

Park, S. I., & Lee, I. J. (2021). A study on sports sponsorship printing advertisement using eye-tracking. The Korean Journal of Sport, 19(1), 347-355.

[https://doi.org/10.46669/kss.2021.19.1.031]

-

Ryu, M. H. (2019). Focused movement characteristics of jewelry advertisement image using eye tracking technique. Design Research, 4(4), 167-177.

[https://doi.org/10.46248/kidrs.2019.4.167]

-

Song, H. S. (2018). Elementary school students' eye tracking research in search of contents of practical arts textbooks. Journal of Korean practical arts education, 31(4), 69-89.

[https://doi.org/10.24062/kpae.2018.31.4.69]

- ‘Tobii EyeX’. (n. d.). airdailyx.net. Retrieved March 07, 2018, from https://www.airdailyx.net/fsnewsbreaker/2016/1/11/tobii-eyexꠓcontroller-could-this-replace-trackir

- Wang, W. N., Park, M. H., Hwang, M. K., & Kwon, M. W. (2021). The effect of PPL on the user’s visual attention using eye-tracking. Journal of the Korea Contents Association, 21(2), 445-452.

-

Zhang, J. N., Du, L., Xie, Y., & Zou, F. Y. (2014). A literature review of using eye tracking technology in fashion and product design, Applied Mechanics and Materials, 536-537, 1662-1668.

[https://doi.org/10.4028/www.scientific.net/AMM.536-537.1662]

-

Zofija, T. O., & David, T. (2020). Clustering consumers' shopping journeys - Eye tracking fashion m-retail, Journal of Fashion Marketing and Management, 24(3), 381-398.

[https://doi.org/10.1108/JFMM-09-2019-0195]